引述外媒报道,先进的AI和机器学习算法可以生成逼真的位置和物体图像,但它们也擅长将人与人之间的面孔互换,并发现复杂的深造假品。在微软研究院和北京大学的团队发表的两篇学术论文中,研究人员提出了FaceShifter和Face X-Ray,这是一种用于高保真度和遮挡意识的面部交换框架,以及一种用于检测伪造面部图像的表示形式。他们说,在不牺牲性能的前提下,两者均与多个基准相比均达到了行业领先的结果,并且与以前的方法相比,它们所需的数据要少得多。

FaceShifter解决了将目标图像中的一个人替换为源图像中的另一个人的问题,同时保留了头部姿势,面部表情,光线,颜色,强度,背景和其他属性。像Reflect和FaceSwap这样的应用程序声称可以相当准确地完成此操作,但是Microsoft论文的合著者断言,它们对姿势和透视图变化敏感。

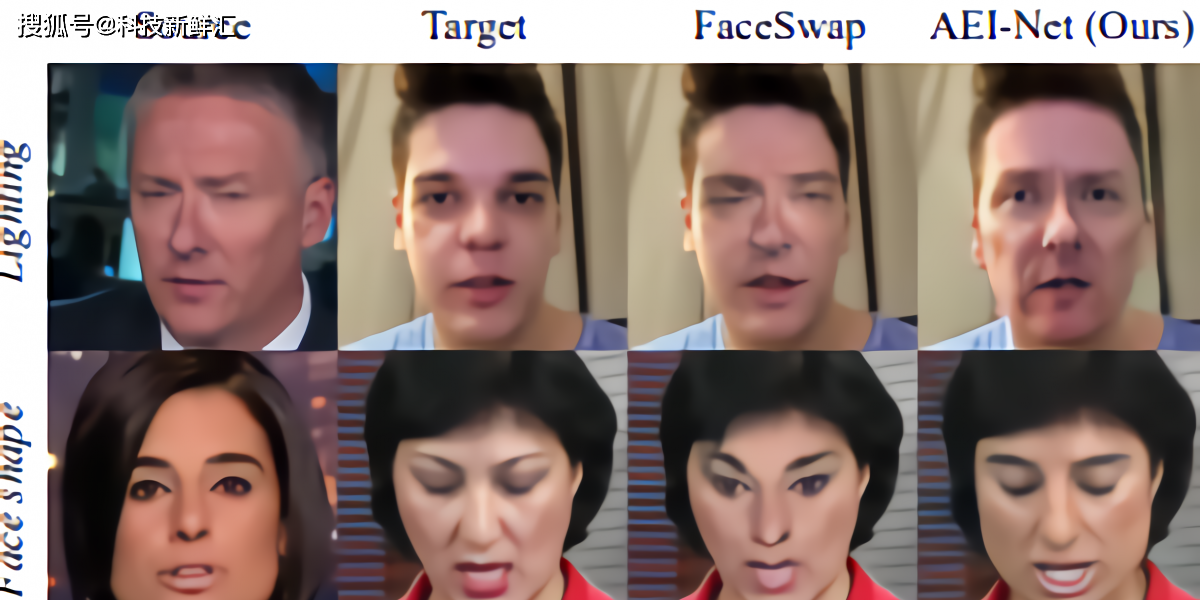

FaceShifter通过生成对抗网络(GAN)来增强人脸交换的保真度-一种由生成器组成的AI模型,该生成器试图欺骗鉴别器以将合成样本归类为真实样本,称为自适应嵌入集成网络(AEI-Net),该引擎提取属性在各种空间分辨率下。新颖的是,该生成器结合了研究人员所谓的注意力非正规化(AAD)层,可自适应地学习在哪里整合面部属性,而单独的模型(启发式错误确认细化网络(HEAR-Net))则利用了重建图像及其输入之间的差异。

该团队表示,在一项定性测试中,FaceShifter保留了脸部形状并忠实地尊重了目标的照明和图像分辨率。此外,即使在从互联网上刮掉的“狂野面孔”上,该框架也学会了在不依赖于人类注释数据的情况下恢复异常区域(包括眼镜,阴影和反射效果以及其他不常见的遮挡)。

“所提出的框架显示出在给定任何面部对的情况下生成逼真的面部图像的卓越性能,而无需经过特定学科的培训。大量的实验表明,所提出的框架明显优于以前的人脸交换方法。”研究小组写道。

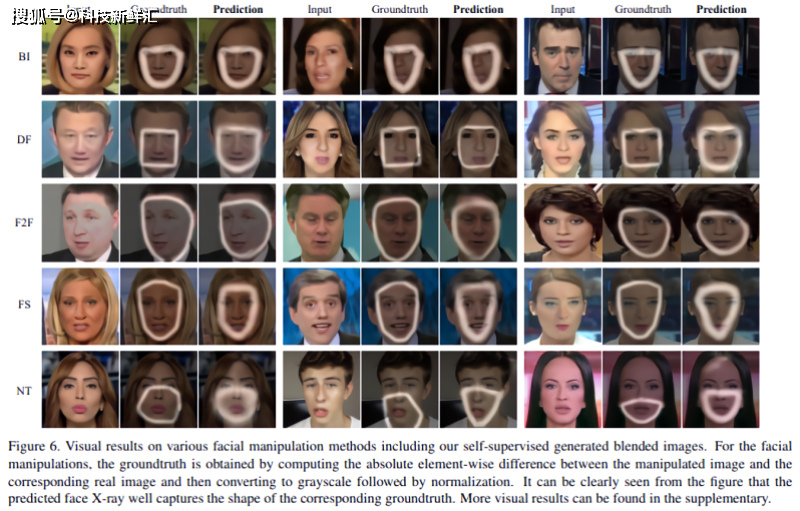

与FaceShifter相比,Face X-Ray尝试检测爆头何时可能是伪造的。正如相应论文中的研究人员所指出的那样,确实需要诸如此类的工具-伪造的图像可能出于恶意目的而被滥用。2019年6月,一份报告显示,一名间谍使用AI生成的个人资料照片来欺骗LinkedIn中的联系人。就在去年12月,Facebook发现了数百个帐户,其中包含使用AI合成的假脸的个人资料照片。

与现有工作不同,FaceShifter不需要掌握操作方法或人工监督。相反,它生成灰度图像,揭示给定的输入图像是否可以分解为来自不同来源的两个图像的混合。该团队声称这是可行的,因为大多数脸部操作方法在将更改过的脸部融合到现有背景图像中共享一个共同的步骤。每个图像都有从硬件(如传感器和镜头)或软件组件(如压缩和合成算法)中引入的自己独特的标记,并且这些标记在整个图像中趋向于类似呈现。

因此,人脸X射线不需要依赖与特定人脸操作技术相关的伪像的知识,并且可以在不使用任何方法生成伪图像的情况下训练构成其基础的算法。

在一系列实验中,研究人员在FaceForensics ++上对Face X-Ray进行了训练,FaceForensics ++是一种大型视频语料库,其中包含使用四种最新的面部操作方法进行操作的1,000多个原始剪辑,以及包含从真实图像构建的混合图像。他们评估了Face X-Ray归纳四个数据集的能力,其中包括上述FaceForensics ++语料库的一个子集。Google发行了成千上万的可视化Deepfake视频,以促进Deepfake检测方法的发展;来自Deepfake检测挑战的图像; 以及Celeb-DF,这是一个包含408个真实视频和795个具有减少的视觉假象的合成视频的语料库。

结果表明,Face X-Ray能够区分以前看不见的伪造图像并可靠地预测混合区域。研究小组指出,他们的方法依赖于混合步骤的存在,因此可能不适用于完全合成的图像,并且可能会被对抗性样本击败。除此之外,他们说这是迈向普通人脸伪造检测器的有希望的一步。

金大立免费服务热线

金大立免费服务热线 地址:成都彭州市工业开发区天彭镇旌旗西路419号

地址:成都彭州市工业开发区天彭镇旌旗西路419号二维码